Premium Only Content

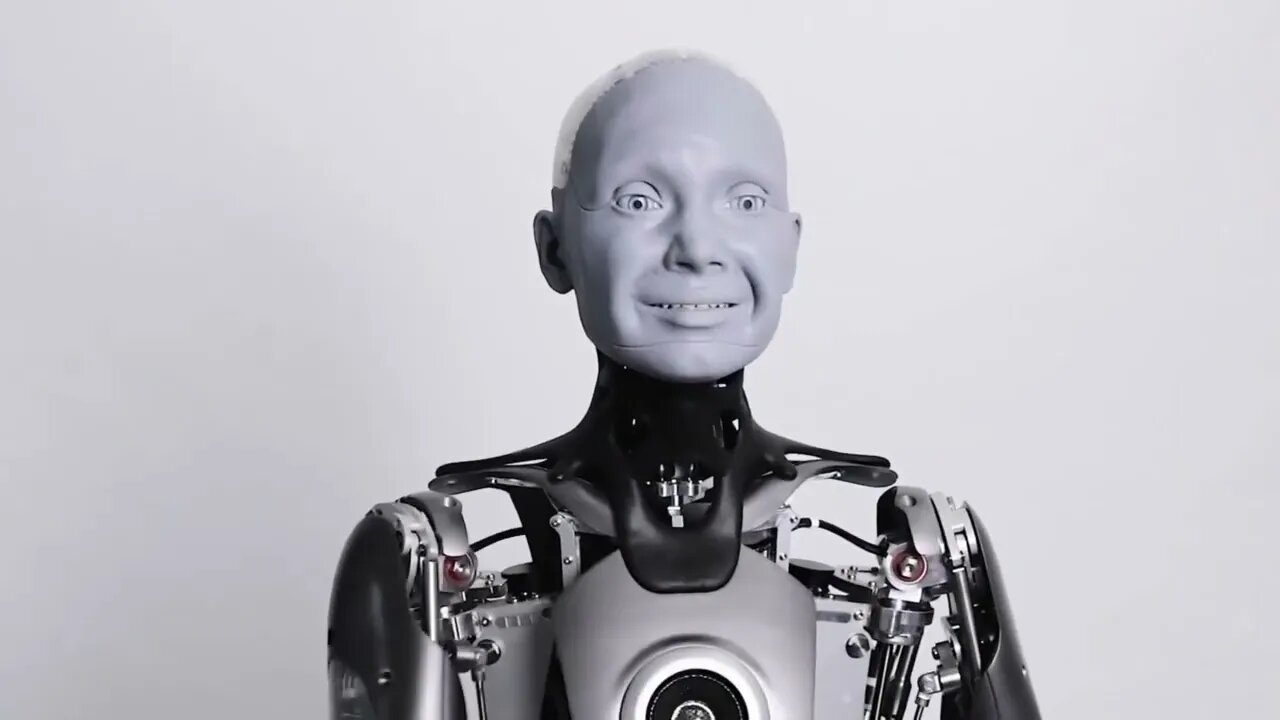

#44 Sinais fisiológicos podem ser a chave para IA 'emocionalmente inteligente'

A inteligência artificial está na vanguarda da tecnologia moderna. Tornar a IA 'emocionalmente inteligente' pode abrir portas para interações homem-máquina mais naturais. Para fazer isso, ele precisa captar o sentimento do usuário durante um diálogo. Sinais fisiológicos podem fornecer uma rota direta para tais sentimentos. Agora, pesquisadores do Japão levam as coisas para o próximo nível com uma IA com capacidades de detecção de sentimentos comparáveis às dos humanos.

"Análise de sentimento multimodal" é um grupo de métodos que constituem o padrão-ouro para um sistema de diálogo de IA com detecção de sentimento. Esses métodos podem analisar automaticamente o estado psicológico de uma pessoa a partir de sua fala, tom da voz, expressão facial e postura e são cruciais para sistemas de IA centrados no ser humano. A técnica poderia potencialmente realizar uma IA emocionalmente inteligente com capacidades além do humano, que entende o sentimento do usuário e gera uma resposta de acordo.

No entanto, os métodos atuais de estimativa de emoções focam apenas em informações observáveis e não levam em conta as informações contidas em sinais não observáveis, como sinais fisiológicos. Esses sinais são uma potencial mina de ouro de emoções que podem melhorar tremendamente o desempenho da estimativa de sentimento.

Em um novo estudo, os sinais fisiológicos foram adicionados à análise multimodal de sentimentos pela primeira vez por pesquisadores do Japão. Os seres humanos são muito bons em esconder seus sentimentos. O estado emocional interno de um usuário nem sempre é refletido com precisão pelo conteúdo do diálogo, mas como é difícil para uma pessoa controlar conscientemente seus sinais biológicos, como frequência cardíaca, pode ser útil usá-los para estimar seu estado emocional. Isso pode resultar em uma IA com recursos de estimativa de sentimentos que estão além dos humanos.

A equipe analisou 2.468 diálogos com a IA obtida de 26 participantes para estimar o nível de prazer experimentado pelo usuário durante a conversa.

Ao comparar todas as fontes de informação separadas, a informação do sinal biológico provou ser mais eficaz do que a voz e a expressão facial. O desempenho da IA tornou-se comparável ao de um humano.

-

5:28

5:28

Pingos de ciência

2 years ago#113 O núcleo da Terra parou? 24/01/23

141 -

LIVE

LIVE

freecastle

3 hours agoTAKE UP YOUR CROSS- CREATED IN HIS IMAGE

134 watching -

1:49:30

1:49:30

The Quartering

4 hours agoCount Dankula Live On Migrant Crisis In Europe, Whiteness & More

121K156 -

3:46:59

3:46:59

Barry Cunningham

8 hours agoBREAKING NEWS: KAROLINE LEAVITT HOLDS WHITE HOUSE PRESS CONFERENCE (AND MORE NEWS)

72K52 -

47:21

47:21

Stephen Gardner

21 hours ago🔥Elon Just Exposed the Most Corrupt Man on Earth - Trump Makes BOLD MOVE!

36.1K106 -

56:48

56:48

The HotSeat

2 hours agoI'm NOT Sorry! Guns Aren’t the Problem—Godless Culture Is

17.2K15 -

![[Ep 737] Media & Left Attack Prayer and God | Media Loses Control of Narrative | CDL Fraud](https://1a-1791.com/video/fww1/ca/s8/1/m/N/f/d/mNfdz.0kob-small-Ep-736-Make-Gender-Dysphori.jpg) LIVE

LIVE

The Nunn Report - w/ Dan Nunn

2 hours ago[Ep 737] Media & Left Attack Prayer and God | Media Loses Control of Narrative | CDL Fraud

207 watching -

2:53:12

2:53:12

Right Side Broadcasting Network

8 hours agoLIVE REPLAY: White House Press Secretary Karoline Leavitt Holds a Press Briefing - 8/28/25

120K44 -

1:38:09

1:38:09

Simply Bitcoin

6 hours ago $2.48 earnedIs This Your LAST Chance to Buy Bitcoin Before the GENERATIONAL Bull Run Begins? | EP 1320

32.5K2 -

LIVE

LIVE

StoneMountain64

4 hours ago#1 WARZONE TACTICIAN + New Battlefield Trailer

144 watching